PLOS ONE ( IF 2.9 ) Pub Date : 2019-01-16 , DOI: 10.1371/journal.pone.0210630 Jonathan Huang , Max Kinateder , Matt J. Dunn , Wojciech Jarosz , Xing-Dong Yang , Emily A. Cooper

|

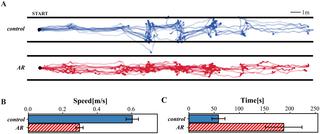

People typically rely heavily on visual information when finding their way to unfamiliar locations. For individuals with reduced vision, there are a variety of navigational tools available to assist with this task if needed. However, for wayfinding in unfamiliar indoor environments the applicability of existing tools is limited. One potential approach to assist with this task is to enhance visual information about the location and content of existing signage in the environment. With this aim, we developed a prototype software application, which runs on a consumer head-mounted augmented reality (AR) device, to assist visually impaired users with sign-reading. The sign-reading assistant identifies real-world text (e.g., signs and room numbers) on command, highlights the text location, converts it to high contrast AR lettering, and optionally reads the content aloud via text-to-speech. We assessed the usability of this application in a behavioral experiment. Participants with simulated visual impairment were asked to locate a particular office within a hallway, either with or without AR assistance (referred to as the AR group and control group, respectively). Subjective assessments indicated that participants in the AR group found the application helpful for this task, and an analysis of walking paths indicated that these participants took more direct routes compared to the control group. However, participants in the AR group also walked more slowly and took more time to complete the task than the control group. The results point to several specific future goals for usability and system performance in AR-based assistive tools.

中文翻译:

为视力不佳的用户提供的增强现实标志阅读助手

人们在找到不熟悉的位置时通常会严重依赖视觉信息。对于视力低下的人,如有需要,可以使用多种导航工具来协助完成此任务。但是,为了在不熟悉的室内环境中进行寻路,现有工具的适用性受到限制。一种辅助此任务的潜在方法是增强有关环境中现有标牌的位置和内容的视觉信息。为此,我们开发了一个原型软件应用程序,该应用程序运行在消费者头戴式增强现实(AR)设备上,以帮助视觉障碍的用户阅读标志。标牌阅读助手可根据命令识别真实的文字(例如标牌和房间号),突出显示文字位置,将其转换为高对比度的AR字体,并可以选择通过文本语音朗读内容。我们在行为实验中评估了此应用程序的可用性。要求有模拟视力障碍的参与者在有或没有AR协助的情况下在走廊内找到特定的办公室(分别称为AR组和对照组)。主观评估表明,AR组的参与者发现该应用程序对该任务很有帮助,而对步行路径的分析表明,与对照组相比,这些参与者采取了更多的直接路线。但是,与对照组相比,AR组的参与者走得更慢,花了更多的时间来完成任务。结果指出了基于AR的辅助工具中可用性和系统性能的几个特定的未来目标。我们在行为实验中评估了此应用程序的可用性。要求模拟视力障碍的参与者在有或没有AR辅助的情况下在走廊内找到特定的办公室(分别称为AR组和对照组)。主观评估表明,AR组的参与者发现该应用程序对该任务很有帮助,而对步行路径的分析表明,与对照组相比,这些参与者采取了更多的直接路线。但是,与对照组相比,AR组的参与者走得更慢,花了更多的时间来完成任务。结果指出了基于AR的辅助工具中可用性和系统性能的几个特定的未来目标。我们在行为实验中评估了此应用程序的可用性。要求模拟视力障碍的参与者在有或没有AR辅助的情况下在走廊内找到特定的办公室(分别称为AR组和对照组)。主观评估表明,AR组的参与者发现该应用程序对该任务很有帮助,而对步行路径的分析表明,与对照组相比,这些参与者采取了更多的直接路线。但是,与对照组相比,AR组的参与者走得更慢,花了更多的时间来完成任务。结果指出了基于AR的辅助工具中可用性和系统性能的几个特定的未来目标。要求模拟视力障碍的参与者在有或没有AR辅助的情况下在走廊内找到特定的办公室(分别称为AR组和对照组)。主观评估表明,AR组的参与者发现该应用程序对该任务很有帮助,而对步行路径的分析表明,与对照组相比,这些参与者采取了更多的直接路线。但是,与对照组相比,AR组的参与者走得更慢,花了更多的时间来完成任务。结果指出了基于AR的辅助工具中可用性和系统性能的几个特定的未来目标。要求模拟视力障碍的参与者在有或没有AR辅助的情况下在走廊内找到特定的办公室(分别称为AR组和对照组)。主观评估表明,AR组的参与者发现该应用程序对该任务很有帮助,而对步行路径的分析表明,与对照组相比,这些参与者采取了更多的直接路线。但是,与对照组相比,AR组的参与者走得更慢,花了更多的时间来完成任务。结果指出了基于AR的辅助工具中可用性和系统性能的几个特定的未来目标。主观评估表明,AR组的参与者发现该应用程序对该任务很有帮助,而对步行路径的分析表明,与对照组相比,这些参与者采取了更多的直接路线。但是,与对照组相比,AR组的参与者走得更慢,花了更多的时间来完成任务。结果指出了基于AR的辅助工具中可用性和系统性能的几个特定的未来目标。主观评估表明,AR组的参与者发现该应用程序对该任务很有帮助,而对步行路径的分析表明,与对照组相比,这些参与者采取了更多的直接路线。但是,与对照组相比,AR组的参与者走得更慢,花了更多的时间来完成任务。结果指出了基于AR的辅助工具中可用性和系统性能的几个特定的未来目标。

京公网安备 11010802027423号

京公网安备 11010802027423号