International Journal of Applied Earth Observation and Geoinformation ( IF 7.5 ) Pub Date : 2018-01-04 , DOI: 10.1016/j.jag.2017.12.012 Junfeng Gao , Wenzhi Liao , David Nuyttens , Peter Lootens , Jürgen Vangeyte , Aleksandra Pižurica , Yong He , Jan G. Pieters

|

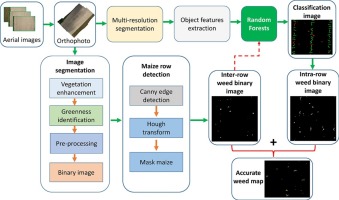

The developments in the use of unmanned aerial vehicles (UAVs) and advanced imaging sensors provide new opportunities for ultra-high resolution (e.g., less than a 10 cm ground sampling distance (GSD)) crop field monitoring and mapping in precision agriculture applications. In this study, we developed a strategy for inter- and intra-row weed detection in early season maize fields from aerial visual imagery. More specifically, the Hough transform algorithm (HT) was applied to the orthomosaicked images for inter-row weed detection. A semi-automatic Object-Based Image Analysis (OBIA) procedure was developed with Random Forests (RF) combined with feature selection techniques to classify soil, weeds and maize. Furthermore, the two binary weed masks generated from HT and OBIA were fused for accurate binary weed image. The developed RF classifier was evaluated by 5-fold cross validation, and it obtained an overall accuracy of 0.945, and Kappa value of 0.912. Finally, the relationship of detected weeds and their ground truth densities was quantified by a fitted linear model with a coefficient of determination of 0.895 and a root mean square error of 0.026. Besides, the importance of input features was evaluated, and it was found that the ratio of vegetation length and width was the most significant feature for the classification model. Overall, our approach can yield a satisfactory weed map, and we expect that the obtained accurate and timely weed map from UAV imagery will be applicable to realize site-specific weed management (SSWM) in early season crop fields for reducing spraying non-selective herbicides and costs.

中文翻译:

融合像素和基于对象的特征以使用无人机图像进行杂草制图

无人机(UAV)和先进的成像传感器的使用发展为在精密农业应用中超高分辨率(例如,小于10厘米的地面采样距离(GSD))作物田地监测和制图提供了新的机会。在这项研究中,我们开发了一种从空中视觉图像中检测早季玉米田中行间和行内杂草的策略。更具体地说,将霍夫变换算法(HT)应用于正畸定位图像以进行行间杂草检测。利用随机森林(RF)结合特征选择技术开发了一种半自动的基于对象的图像分析(OBIA)程序,以对土壤,杂草和玉米进行分类。此外,将由HT和OBIA生成的两个二元杂草遮罩融合在一起,以获得准确的二元杂草图像。通过5倍交叉验证对开发的RF分类器进行评估,其总体准确度为0.945,Kappa值为0.912。最后,通过拟合系数为0.895,均方根误差为0.026的拟合线性模型,对检测到的杂草及其地面真相密度之间的关系进行定量。此外,评估了输入特征的重要性,发现植被长宽比是分类模型中最重要的特征。总体而言,我们的方法可以产生令人满意的杂草图,并且我们希望从无人机图像中获得的准确,及时的杂草图将可用于实现早季作物田地的特定地点杂草管理(SSWM),以减少喷洒的非选择性除草剂和费用。总体精度为0.945,Kappa值为0.912。最后,通过拟合系数为0.895,均方根误差为0.026的拟合线性模型,对检测到的杂草及其地面真相密度之间的关系进行定量。此外,评估了输入特征的重要性,发现植被长宽比是分类模型中最重要的特征。总体而言,我们的方法可以产生令人满意的杂草图,并且我们希望从无人机图像中获得的准确,及时的杂草图将可用于实现早季作物田地的特定地点杂草管理(SSWM),以减少喷洒的非选择性除草剂和费用。总体精度为0.945,Kappa值为0.912。最后,通过拟合系数为0.895,均方根误差为0.026的拟合线性模型,对检测到的杂草及其地面真相密度之间的关系进行定量。此外,评估了输入特征的重要性,发现植被长宽比是分类模型中最重要的特征。总体而言,我们的方法可以产生令人满意的杂草图,并且我们希望从无人机图像中获得的准确,及时的杂草图将可用于实现早季作物田地的特定地点杂草管理(SSWM),以减少喷洒的非选择性除草剂和费用。通过拟合线性模型对杂草与其地面实在密度的关系进行定量,确定系数为0.895,均方根误差为0.026。此外,评估了输入特征的重要性,发现植被长宽比是分类模型中最重要的特征。总体而言,我们的方法可以产生令人满意的杂草图,并且我们希望从无人机图像中获得的准确,及时的杂草图将可用于实现早季作物田地的特定地点杂草管理(SSWM),以减少喷洒的非选择性除草剂和费用。通过拟合线性模型对杂草与其地面实在密度的关系进行定量,确定系数为0.895,均方根误差为0.026。此外,评估了输入特征的重要性,发现植被长宽比是分类模型中最重要的特征。总体而言,我们的方法可以产生令人满意的杂草图,并且我们希望从无人机图像中获得的准确,及时的杂草图将可用于实现早季作物田地的特定地点杂草管理(SSWM),以减少喷洒的非选择性除草剂和费用。通过评估输入特征的重要性,发现植被长宽比是分类模型中最重要的特征。总体而言,我们的方法可以产生令人满意的杂草图,并且我们希望从无人机图像中获得的准确,及时的杂草图将可用于实现早季作物田地的特定地点杂草管理(SSWM),以减少喷洒的非选择性除草剂和费用。通过评估输入特征的重要性,发现植被长宽比是分类模型中最重要的特征。总体而言,我们的方法可以产生令人满意的杂草图,并且我们希望从无人机图像中获得的准确,及时的杂草图将可用于实现早季作物田地的特定地点杂草管理(SSWM),以减少喷洒的非选择性除草剂和费用。

京公网安备 11010802027423号

京公网安备 11010802027423号